2026年のGDPRビデオコンプライアンスでは、一般データ保護規則(GDPR)の厳しい基準を満たすために、視覚メディア内の生体識別子を匿名化する必要があります。

現在のコンプライアンス要件は、単なるマスキングから「法医学的レベルのプライバシー」にシフトしており、法医学的デピクセレーションを防止する先進的な修正ソフトウェアの使用が求められます。これらのデータプライバシー規制を実施しない場合、GDPRの執行が厳格に行われ、大きな行政罰が科されます。

GDPRとは何か、なぜビデオコンプライアンスが変わったのか?

現在の状況を理解するためには、まずGDPRの意味を問う必要があります。一般データ保護規則(GDPR)はEU市民のデジタルプライバシーを保護するためのGDPRコンプライアンスフレームワークです。2026年現在、現在のGDPRの執行ニュースは、CCTVやソーシャルメディアマーケティングの映像で「匿名化が不完全」であることが原因で罰金が急増していることを示しています。

データ保護当局は「擬似化」(可逆)と「匿名化」(非逆)を区別しています。GDPRの原則の下では、高リスクのデータセキュリティに対して、単に顔の上に静的なボックスを置くことはもう十分ではありません。

要点: 2026年のコンプライアンス情勢

- 生体認証のフォーカス: 顔の幾何学は高リスクの機微データとして分類されます。

- 不可逆性: ぼかしがAIによって逆転可能であれば、データ漏洩とされます。

- エッジ処理: ローカルで処理されたデータは、監査人から好意的に見られます。

2026年GDPRビデオプライバシーチェックリスト

EUで人間を被写体とするビデオを公開または保存する前に、次の6つの重要な要件をチェックするワークフローを確立してください:

- 処理の法的根拠: 映像を撮影するための法的根拠(例:正当な利益または同意)を特定しましたか?(GDPR第6条を参照)。

- データ最小化: 宣言された目的に必要な映像のみを撮影していますか?プライバシーが期待されるエリアでの「オーバーシューティング」を避けてください。

- 自動匿名化: 同意していない被写体に対してプライバシー・マスキングを適用しましたか?高ボリュームの映像に対して、手動のぼかしは「十分な技術的対策」とは見なされません。

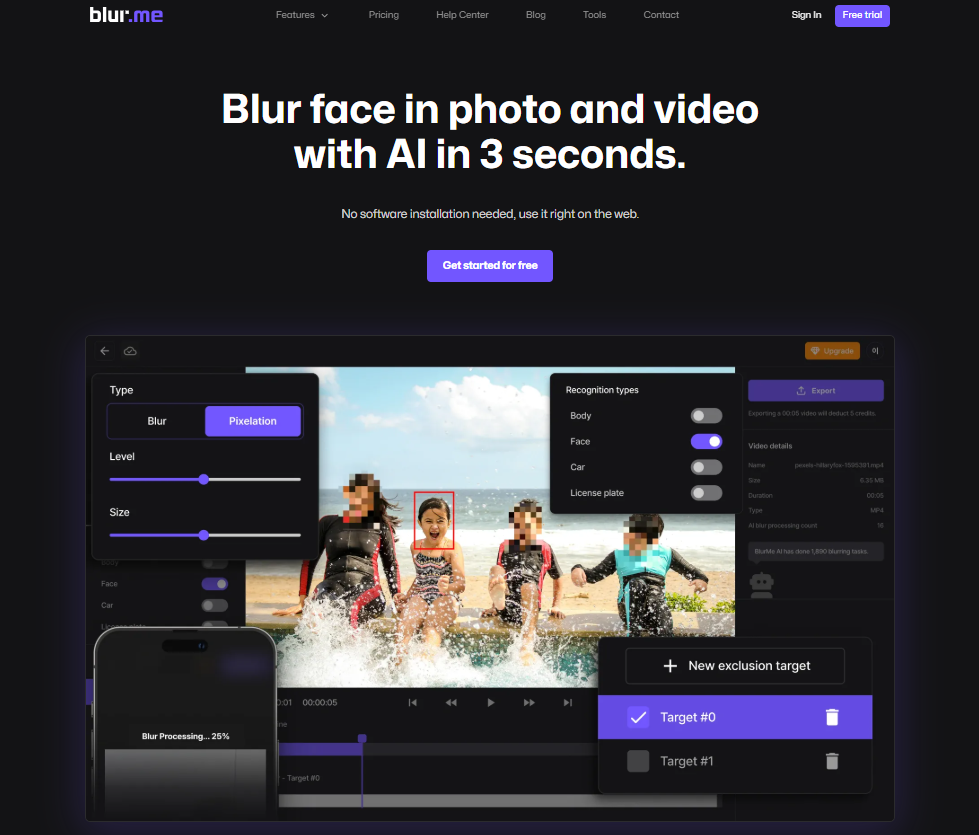

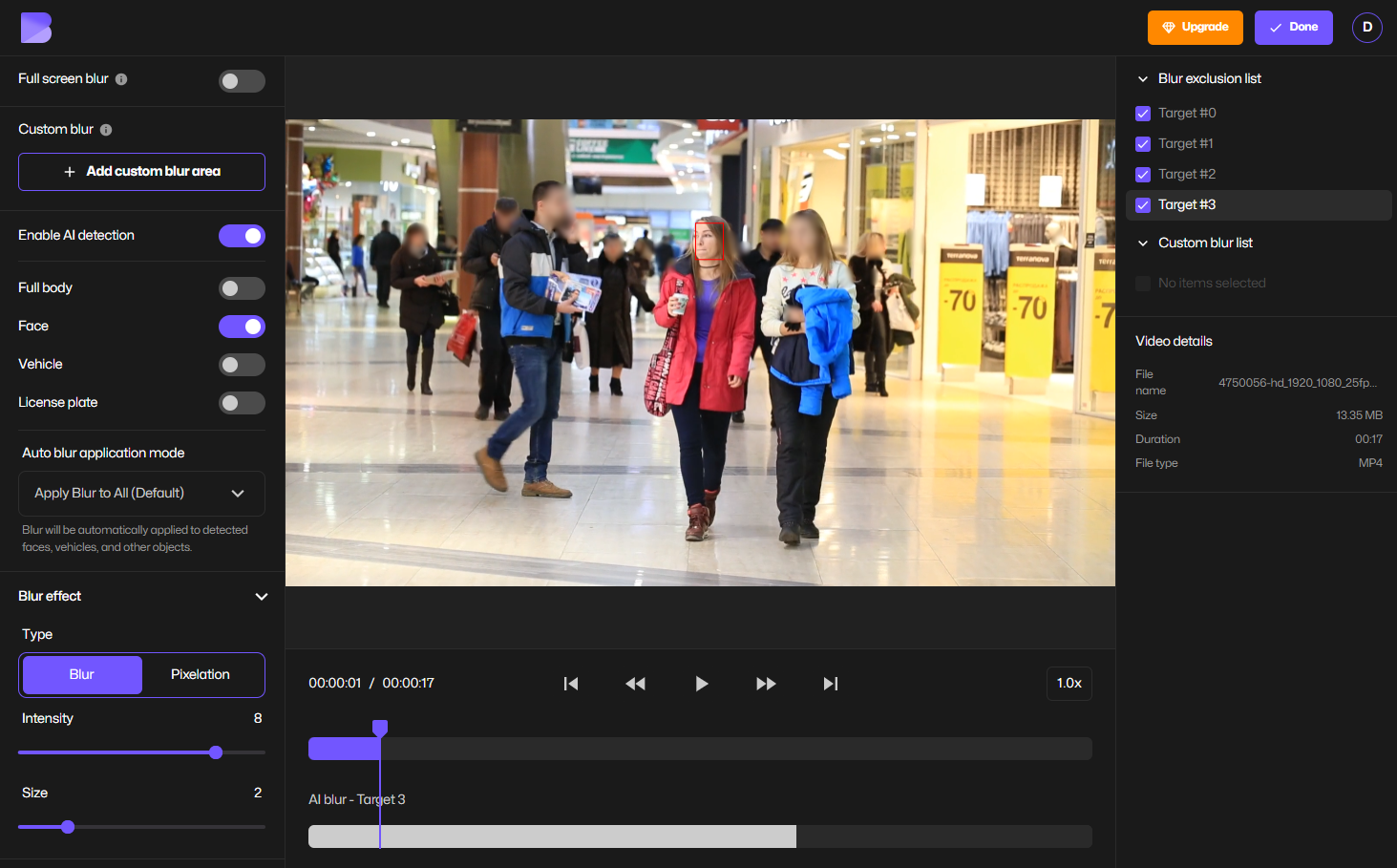

- ソリューション: BlurMeの自動顔ぼかしを使用して、生体データが見逃されないようにします。

- 法医学レベルの修正: あなたの修正方法は、法医学的デピクセレーションを防ぎますか?単純なピクセレーションでは2026年の「不可逆性」基準を満たさない場合があります。

- メタデータのサニタイズ: ビデオファイルからEXIFデータ、GPS座標、デバイス識別子を削除しましたか?

- データ主体のアクセス要求(DSAR)への対応準備: 個人が自分のデータの削除または匿名化を要求した場合、そのビデオを迅速に処理するワークフローはありますか?

技術的ニュアンス: 法医学的デピクセレーションの危険性

2026年の重要な要因は、法医学的デピクセレーションの台頭です。伝統的なピクセレーション—ピクセルの塊の色値を平均化すること—は、今や「インバース・ディフュージョン」AIモデルに対して脆弱です。これらのモデルは、驚くべき精度で元の顔を「幻覚」することができます。

Wojciech Wiewiórowski欧州データ保護監督者(EDPS)が強調するように、技術が進化するにつれて匿名化がより困難になっていますが、それはデータ保護のためのゴールドスタンダードであり続けます。

基本的なピクセレーションから高エントロピーのプライバシー・マスキングへの移行がもはやオプションではないことを強調しています。一般データ保護規則(GDPR)の下では、「使用する可能性があると合理的に考えられる手段」がぼかしを逆転できるならば、データは真に匿名化されているとは言えません。

データ保護を確保するためには、プロの修正ソフトウェアは高エントロピーのガウシアンカーネルやソリッドフィルマスキングを使用しなければなりません。これにより、基盤となる生体データが単に隠されるだけでなく、数学的に破壊されることを保証します。情報委員会による匿名化の紹介によれば、真に匿名化されたデータはすべての「使用する可能性があると合理的に考えられる手段」によって特定されないことを保証しなければなりません。

セキュリティレベルの匿名化

修正による手動の匿名化は、多くの有名な法的書類で見られるように、人為的なミスが起こりがちです。しかし、BlurMeのAI修正ソフトウェアのようなツールを使用することで、生体データが数学的に回復不可能となり、最も厳しいコンプライアンス要件を満たすことができます。

2026年の監視ビデオにおけるGDPRに準拠する方法

GDPRビデオコンプライアンスを維持するためには、監視戦略をデザインによるプライバシー(第25条)へとシフトさせる必要があります。これにより、データワークフローに匿名化を直接統合し、生体データがリスク要因になることを防ぎます。

戦略的解決策: BlurMe AIによる自動修正

長時間のCCTV映像を手動で編集することは非効率的であり、「プライバシーギャップ」を生じさせる可能性があります。単一のフレームが露出し、GDPR違反が発生する恐れがあります。

BlurMeは、2026年のコンプライアンス要件を満たすように設計されています。以下を提供します:

- 持続的AIトラッキング: 私たちのエンジンは、移動する被写体に対して4K監視フィード全体でプライバシー・マスキングのロックを維持し、フレームスキップが発生しないようにします。

- 法医学レベルの難読化: 脆弱なピクセレーションを超えて進化します。BlurMeは、法医学的デピクセレーションの試みに対して免疫性のある高エントロピーのガウシアンカーネルを使用します。

- DSAR用のバルク修正: 大量のアクセスリクエストに対応する際には、Blur CCTVエンタープライズソリューションによって、複数のカメラフィードを同時に処理でき、一般データ保護規則(GDPR)を満たすための管理負担を大幅に軽減します。

GDPRに対する匿名化方法の比較

ビデオでのGDPRコンプライアンスフレームワークの実装

GDPRが保護しようとするものについて考えた場合、その答えは基本的なプライバシー権です。ビデオをぼかすために、組織はCISA修正ガイドラインに従わなければなりません。それは「修正は、配布可能となるようにドキュメントやメディアから機密情報を削除するプロセスです」と強調しています。

「2026年に見られるシフトは、'十分な'プライバシーから'証明可能な'プライバシーへの移行です」とマーカス・ソーン、シニアデータプライバシー監査官は述べています。「あなたのプライバシー・マスキングがメタデータや反射による再識別を考慮していない場合、あなたはコンプライアンス違反です。」

ビデオ内の顔をぼかす必要があるチーム向けに、ワークフローは手動エラーによる「フレームスキッピング」を避けるために自動化されている必要があります。BlurMeの顔ぼかしツールを利用することで、データプライバシー法に準拠した持続的な追跡が可能です。

要点: 技術的要件

- メタデータ削除: 修正はGPSおよびデバイスEXIFデータの削除を含まなければなりません。

- 反射マスキング: 背景の窓や鏡が被写体の身元を漏らさないようにします。

- 監査証跡: ビデオがいつどのように修正されたかのログを保持します。

GDPR執行におけるAIの役割

以前の分析で議論された通り、GDPR準拠のためのビデオのぼかし、一般データ保護規則(GDPR)は現在自動化されたクローラーによって執行されています。これらのボットは、公開されているビデオをマスクされていない顔がないかどうかスキャンします。大規模な映像アーカイブにわたってコンプライアンス要件を拡張するためには専用のBlur Videoツールを利用することが唯一の方法です。

Q&A: 上級GDPRビデオコンプライアンス

Q: GDPRは公共の場で撮影されたビデオにも適用されますか?

A: はい。EU GDPRの下では、公共のスペースで個人を特定可能な画像を撮影および保存することは、個人データを処理することに該当します。GDPRの原則は、この処理のための法的根拠を必要とし、同意が得られていない場合は多くの場合プライバシー・マスキングが要求されます。

Q: AIは本当にぼかされた顔を逆転できますか?

A: 法医学的デピクセレーションを通じて、AIはしばしば低解像度のピクセレーションから特徴を再構成できます。これを防ぐために、データセキュリティ標準は、オリジナルのピクセルデータを残さない高変動のぼかしやソリッドマスキングを推奨しています。

Q: 特定のCCTVのコンプライアンス要件は何ですか?

A: CCTV映像は、GDPRコンプライアンスフレームワークに従わなければなりません。これには「デザインによるプライバシー」を含みます。つまり、サードパーティと共有したり、安全でない環境で保存する前に、映像に自動的に修正ソフトウェアを適用する必要があります。